Deepfake Nedir ve Nasıl Yapılır?

Yazan: Sally Adee

Çeviren: Mert Günçiner

Düzenleyen: Görkem Yıldız

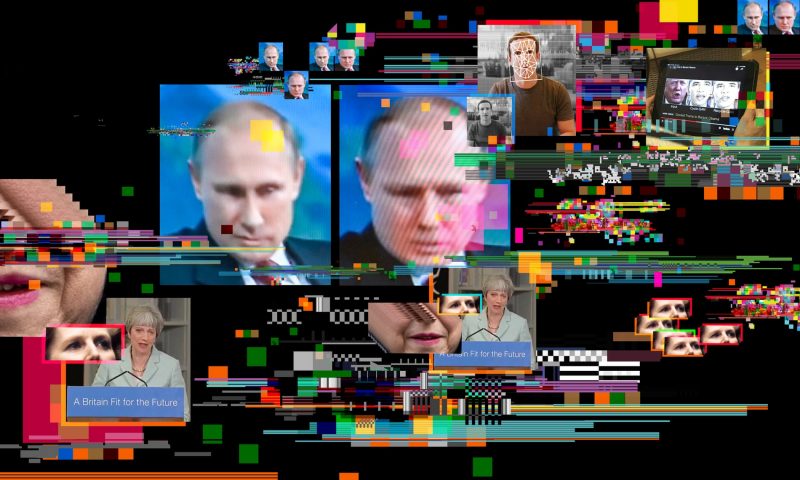

Özet: Deepfake teknolojisinin ilerleyişi gerçeklik algımızı derinden etkileyecek gibi duruyor. Gerçekte yaşanmamış olayları bu teknolojiyi kullanarak var etmek mümkün. Bu bağlamda bazı siyasetçiler kendilerini hiç söylemedikleri sözleri dile getirirken gördü ve bazı ünlüler, içerisinde yer almamış olmalarına rağmen kendilerini çeşitli pornografik içeriklerde boy gösterirken buldular.

Deepfake1 içeriklerin yarattığı kuşkular bazı önlemlerin alınmasının gerekebileceğini düşündürüyor. Yeni çıkarılan yasalar, insanların bu içerikleri yaratmasını ve paylaşmasını engellemeyi amaçlıyor. Sene başında Facebook ve Twitter gibi bazı sosyal medya platformları, deepfake içeriklerin yayımlanmasını yasakladı. Bununla birlikte bu tarz içeriklerden hangi yollarla korunabileceğini anlatan bazı sunumlar paylaşıldı.

Peki ya deepfake nedir ve insanlar neden bu konuda endişeleniyor?

Deepfake Nedir?

Deepfake teknolojisi, herhangi bir insanı aslında hiç bulunmadıkları video veya fotoğrafa, sahte olduğu anlaşılamayacak şekilde yerleştirebilir. Hızlı ve Öfkeli 7 filminde merhum Paul Walker’ın yeniden yer alabilmesi de bu teknolojinin geçmiş senelerdeki örneklerindendi. Eskiden bu gibi işler birçok uzmanlarla büyük stüdyoların koca bir senesini alıyordu. Fakat artık kendi kendine çalışabilen bilgisayar grafikleri programları ve makine öğrenmesi sistemleriyle birlikte deepfake teknolojisi resim ve video üretmeyi daha hızlı başarabiliyor.

“Deepfake” kelimesinin birçok kafa karışıklığı yaratmasıyla birlikte bilgisayar görüşü ve imge işleme2 araştırmacıları bu kelimeye duydukları nefret sayesinde bir araya geldi. Çünkü bu kelime, yapay zekâ tarafından oluşturulan son teknoloji ürünü videolardan tutun dolandırıcılık sayılabilecek herhangi bir fotoğrafa kadar geniş bir alanı kapsıyor.

Aslında zannedildiğinin aksine bazı içerikler deepfake olarak adlandırılmıyor. Buna bir örnek geçmişte Amerika Birleşik Devletleri’nde Demokratik Partiden başkanlığa aday olmuş Michael Bloomberg’ün yer aldığı ünlü “kriket3” videosu. Bu aslında deepfake ile değil de basit video düzenleme teknikleri uygulanarak oluşturulmuştu.

Deepfake İçerikler Nasıl Oluşturuluyor?

Deepfake içeriklerin esas hammaddesi makine öğrenmesi. Bunun sayesinde az masraflı ve çok daha hızlı bir şekilde deepfake içerikleri oluşturulabiliyor. Birisinin deepfake videosunu oluşturmak için önce o kişinin gerçekten yer aldığı bir videosu alınmalı. Daha sonra yapay sinir ağlarıyla4 (neural networks) birlikte bu videodan alınan veriler saatlerce eğitilmeli5. Ancak bu şekilde kişinin farklı açılar ve çeşitli ışık türleri altında alması gerektiği görüntüler gerçekçi bir şekilde taklit edilebiliyor. Artık bilgisayar imgeleri yöntemleriyle eğitilmiş verilerin işlenmesi sayesinde bir insanı başka bir insan üzerine kopyalayabilmek mümkün hale geliyor.

Yapay zekânın uzun sürecek bu işlemi kısaltmasına rağmen gerçekçi bir sonuç alabilmek hâlâ zaman alıyor. Gerçek bir insanı tamamıyla gerçek dışı bir ortamda canlandırabilmek için elle yapılması gereken bazı işlemler de mevcut. Eğitilmiş verilerin oluşturabileceği sahte ve bariz detaylar elle kırpılmalı ama bu işlem o kadar da basit değil.

Çoğu insana göre derin öğrenme algoritmalarından bir tanesi olan çekişmeli üretici ağlar6 (GANs), deepfake alanında kullanılan ana yöntemlerden bir tanesi olacak. GAN ile yaratılmış sahte yüzler gerçek insan yüzleriyle ayırt edilemeyecek düzeyde benzer oluyor. Deepfake uygulamalarının ilk denetimi GAN algoritmaları kullanarak yapıldı. Bu sayede gelecekte herhangi birisi bile kolaylıkla ileri seviye deepfake içerikleri üretebilir.

Bu yöntem üzerine bazı yanlış varsayımlar kurulduğunu belirten SUNY Buffalo Üniversitesinden Siwei Lyu şöyle diyor: “Bugün üretilmiş çoğu deepfake içeriğinde GAN algoritmaları hiç de önemli bir rol oynamıyor aslında.”

GAN algoritmalarının büyük miktarlarda eğitim verisine ihtiyacı olduğu için onlarla çalışmak zor oluyor. Diğer yöntemlerin aksine elde edilen sonuç çok daha zaman alıyor. Fakat daha da önemlisi GAN modelleri resim oluşturmada başarılıyken videolar söz konusu olduğunda aynı verimi sağlamıyorlar. Çünkü görüntüyü kare kare atlatırken, atlatılan karedeki görüntüyle hizalama konusunda zorluk çekiyorlar.

Buna ek olarak çok bilinen sesli deepfake’ler, GAN algoritmasını kullanmıyor bile. Buna bir örnek Kanadalı yapay zekâ şirketi Dessa’nın (Şu an Square şirketi tarafından sahiplenildi.) sohbet programı sunucusu Joe Rogan’ın sesini kullanarak aslında onun hiç de söylememiş olduğu bazı cümleleri söyletmeyi başarmasıydı. Bu içerikte GAN algoritmaları kullanılmamıştı bile. Aslında bugünün deepfake içerikleri çoğunlukla hem yapay zekâ içeren hem de yapay zekâ içermeyen algoritmalar birlikte kullanılarak yaratılıyor.

Deepfake’leri Kim Buldu?

Çoğu başarılı deepfake örnekleri üniversite laboratuvarlarından ve onların yarattıkları girişimlerden vuku buluyor. Örneğin Almanya’daki Münih Teknik Üniversitesinde geliştirilen bir kod sonucu ünlü futbolcu David Beckham’ın dokuz dili akıcı bir şekilde konuştuğunu gösteren bir video yaratılmıştı. Beckham’ın gerçekte bu dokuz dilden sadece birini akıcı şekilde konuşabildiğini de belirtelim.

Massassuchets Teknik Üniversitesinden bazı araştırmacılar eski Amerika Birleşik Devletleri başkanı Richard Nixon’ın, başarısız olmuş Apollo 11 görevinden sonra yaptığı sahte ve ürkütücü bir konuşma videosu oluşturmuştu.

Fakat hükûmetleri bu kadar endişelendiren deepfake içerikleri bunlar değil. Sosyal yaşamda yıkıcı etkiler oluşturabilecek deepfake içerikler için son seviye teknolojilere veya laboratuvarlara ihtiyaç yok. Bunun bazı örneklerini rızasız yapılmış pornografik deepfake içeriklerinde ve bazı diğer olaylarda gördük.

Deepfake ismi 2017 senesinde Reddit sitesinde r/deepfakes takma adlı bir kullanıcıdan ilham alınarak verildi. Google’ın halka açık derin öğrenme kütüphanesini kullanan bu kişi, porno yıldızlarının yüzlerini çeşitli sinema oyuncularının yüzlerine montajlamıştı. Bugün buna benzer kodlar internette çok yaygın şekilde kullanılıyor ve hepsi bu kod temel alınarak üretildi. Fakat bu içeriklerin bir kısmı eğlendirici nitelikte olan düşünce deneyleri olsalar da pek de inandırıcı değiller.

Peki ya herkes neden bu kadar endişeli? Kaliforniya Üniversitesinde dijital adli tıp uzmanı olan Hany Farid şöyle diyor: “Teknoloji her gün ilerliyor ve bu çok doğal. Bireylerin kolayca içerik üretmesini sağlayacak deepfake yöntemlerinin gelişmesinin ne zaman tehlike teşkil edeceğini tahmin edemiyoruz. Fakat bazı tahminler 2 ila 10 yıl arasında değişmekte. Ama uzmanlara göre herkes ileride elindeki akıllı telefonu alıp gerçekçi deepfake içerikleri üretebilecek.”

Deepfake’ler Niçin Kullanılıyor?

Deepfake’lerin sebep olduğu apaçık bir tehlike, kadınların rızası alınmadan üretilen pornografik içerikler. Bu amaçla yürütülen hesaplar internetteki deepfake üreticilerinin %96’sını kapsamakta. Bunların çoğu ünlüler üzerinde kullanılsa da Amsterdam’da bu içeriklerin tespiti üzerine iş yapan Deeptrace firmasında baş araştırmacı olan Henry Ajder’a göre intikam amaçlı üretilen pornografik içeriklerin sayısı her geçen gün artıyor.

Ayrıca zorbalığa uğrayacak sadece kadınlar da olmayacak. Okullarda, iş yerlerinde veya herhangi bir yerde bulunan insanlar kendileri hakkında üretilen küçük düşürücü, itibar kaybettirici ve inandırıcı senaryolar karşısında kolaylıkla zorbalığa uğrayabilir.

Şirketlerin endişesiyse deepfake içeriklerin iş anlaşmaları söz konusu olduğunda dolandırıcılığın mümkün hale gelebilmesi. Henüz doğrulanmamış bazı bildirilere göre dolandırıcılar deepfake ses içeriklerini kullanıp yöneticilerini taklit edip şirket çalışanlarından para çalıyor. Ayrıca haraç kesme sorunu da doğabilir. Bir biyometrik şirketi olan iProoy’un yaptığı ankete göre siber güvenlikle ilgilenen insanların dörtte üçü kimlik sahteciliğinin yapılmasından korkuyor. Kişiyi taklit edebilme yetenekleri sayesinde siber hırsızlar çevrim içi ödemeler yapmak amacıyla kişisel banka hesabına erişebilir ve müşteri hizmetlerini de kolaylıkla kandırabilir.

Hükûmetlere göre en büyük sorun ise demokrasinin zarar görme ihtimali. Eğer bir kadın oyuncuyu porno videosuna montajlayabiliyorsanız o zaman başkanlığa aday bir siyasetçi için de aynısını yapabilirsiniz. 2018 yılında Brezilya’daki São Paulo şehrinin valisi João Doria benzer bir olayda yer almıştı. Kendisinin bir seks partisi videosunda yer aldığını gören evli siyasetçi bunun gerçek olmadığını kanıtlamaya çalıştı. Bir süredir sağlığı kötü durumda olduğu düşünülen Gabon başkanı Ali Bongo, 2018 yılında içinde yer aldığı şüpheli bir video ile halka yeniden güvence verdi ve başarısız kalmış bir darbe girişimini ateşledi.

Henüz doğruluğu kanıtlanmamış bu gibi olayların üzerindeki bilinmezlik tabakası deepfake’lerin tehlikesine işaret ediyor. Çünkü her ne olmuş olursa olsun yalancılar yaptıkları yanlışlardan kolaylıkla sıyrılabilir. Deepfake içeriklerin hâlihazırdaki yaygınlığı sayesinde her insan istediğini yapıp yakalandığı zamansa bunun bir deepfake ürünü olduğunu iddia edip suçunu inkâr edebilir. Aynı hapisten çıkış kartı gibi. Farid şöyle diyor: “Yalancıların foyası ortaya çıkınca bu kartı kullanmaya başladıklarını bugünlerde görüyoruz.”

Zararlı Deepfake İçeriklerini Nasıl Engelleriz?

Amerika Birleşik Devletleri’nde geçtiğimiz yıllarda yeni yasalar çıkarıldı. Pornografik nitelikteki deepfake içerikleri suç sayılacak ve bunlara para cezası verilecek. Aynı zamanda seçimler söz konusu olduğunda deepfake içeriklerin üretilmesi de yasaklanacak. Teksas, Virjinya ve Kaliforniya eyaletleri, deepfake pornolarını suç saydı ve başkan tarafından aralıkta imzalanacak olan ilk federal yasa Ulusal Savunma Yasası’nın bir parçası olacak. Tabii ki bu yasalar yetki alanlarından dolayı ancak o eyaletlerde işlenecek suçlara karşı kullanılabilecek.

Amerika Birleşik Devletleri haricinde Çin ve Güney Kore gibi ülkeler de çeşitli önlemler almakta. Birleşik Krallık’ta intikam pornolarına yönelik yasalar tekrar gözden geçirildi ve bir hukuk komisyonu tarafından deepfake içerikler söz konusu olduğunda nasıl hareket edileceği düşünüldü. Fakat Avrupa Birliği için bu konu çevrim içi meydana gelen diğer dezenformasyonlara kıyasla o kadar da önem teşkil etmiyor.

Amerika Birleşik Devletleri’nin bu kampanyayı yönettiği hesaba katılınca öne sürülen yasaların geçerliliğine ve uygulanabilirliğine yönelik çok az kanıt var.

Çeşitli filigran ve blokzinciri yöntemleriyle bazı laboratuvarlar bu içeriklerin sahte olduğunu tespit edebilme yollarını aradı. Fakat daha inandırıcı deepfake’ler üretmeden kandırılması zor deepfake algılayıcıları yapabilmek o kadar da kolay değil.

Yine de teknoloji şirketleri çeşitli yollar araştırıyor. Berkeley’deki Oxford yerleşkesinden bazı araştırmacıları eğiten Facebook, diğer kurumlarla birlikte bu deepfake algılayıcılarını üretme ve yeni yasaklama yolları bulma amacında. Politikalarında büyük değişiklikler yapan Twitter, anında kaldırılmamış deepfake içeriklerini etiketlemenin yollarını arıyor. YouTube ise şubattan itibaren Amerika Birleşik Devletleri’ndeki seçimleri ve 2020’deki nüfus sayımlarını konu alan deepfake videolarının paylaşımına izin vermeyeceğini bildirdi.

Peki ya bu sınırlar dışında kalan deepfake içeriklere ne olacak? Reality Defender (Gerçeklik Savunucusu) ve Deeptrace (Derin ipucu) adında iki program, deepfake içeriklerini hayatınızdan uzak tutmayı hedefleyecek. Deeptrace, uygulama programlama arayüzü (API) ile çalışıyor ve melez bir antivirüs-spam filtresi karışımı bir role bürünüyor. Kendisine ulaşan içerik inceleniyor ve olası manipülasyon yöntemleri gözetilerek bu içerikler karantinaya alınıyor, tıpkı Gmail’in istenmeyen mesajları size ulaşmadan ayıklamaya başlaması gibi. AI Foundation şirketi tarafından geliştirilme aşamasında olan Reality Defender programı ise benzer nitelikteki oynama yapılmış görüntü ve videoları bir infial yaratmadan paketlemeyi amaçlıyor. Adier şöyle diyor: “Bu gibi içeriklerin doğruluğunu veya yanlışlığını ispatlama yükümlülüğünü bireylerden beklemenin haksızlık olduğunu düşündük.”

[1] Derin öğrenmeden (Deep learning) aşina olduğumuz “Deep” kelimesi ile sahte anlamına gelen “fake” kelimelerinin birleşimiyle oluşturulmuş.

[2] Çeşitli optik araçlarla çevreyi algılayıp onun görüntüsünü oluşturmayı başaran yapay zekânın bir alt kolu.

[3] Amerika Birleşik Devletleri’ne özgü bir spor dalı.

[4] İnsan beyni temel alınarak geliştirilen bilgi işlem teknolojisi. (Kaynak: https://tr.wikipedia.org/wiki/Yapay_sinir_a%C4%9Flar%C4%B1)

[5] Sistemin çalışması ve öğrenmesi için verilen veri türü. Bu verileri kullanarak makine öğrenmesiyle eğitilen sistem ileride incelenecek verilere (test verileri) karşı hazırlıklı hale gelir.

[6] Denetimsiz makine öğrenmesinde kullanılan yapay zekâ algoritmaları sınıfı. (Kaynak: http://buyukveri.firat.edu.tr/2018/03/05/uretici-cekismeli-aglar-generative-adverserial-networks-ile-yeni-yuz-goruntuleri-uretme/)